本文重點:CanIRun.ai 透過 WebGPU 技術自動偵測硬體,以 S 至 F 視覺化分級評估電腦運行開源模型的效果。這款工具免安裝且注重隱私,協助使用者快速找出適合本地環境的 AI 模型。

今天要介紹的「CanIRun.ai」是專為 AI 愛好者設計的線上工具,主要功能是檢測在自己的電腦上可以本地(Local)執行哪些開源模型(例如 Llama、Mistral 或 GPT-OSS),但能不能跑和運行是否流暢又是另外一回事,如果非專業使用者,面對密密麻麻的規格資訊可能很難搞清楚要看哪些項目?CanIRun.ai 能讓我們更快知道應該從哪些 AI 模型開始探索。

自動偵測硬體,隱私安全無虞

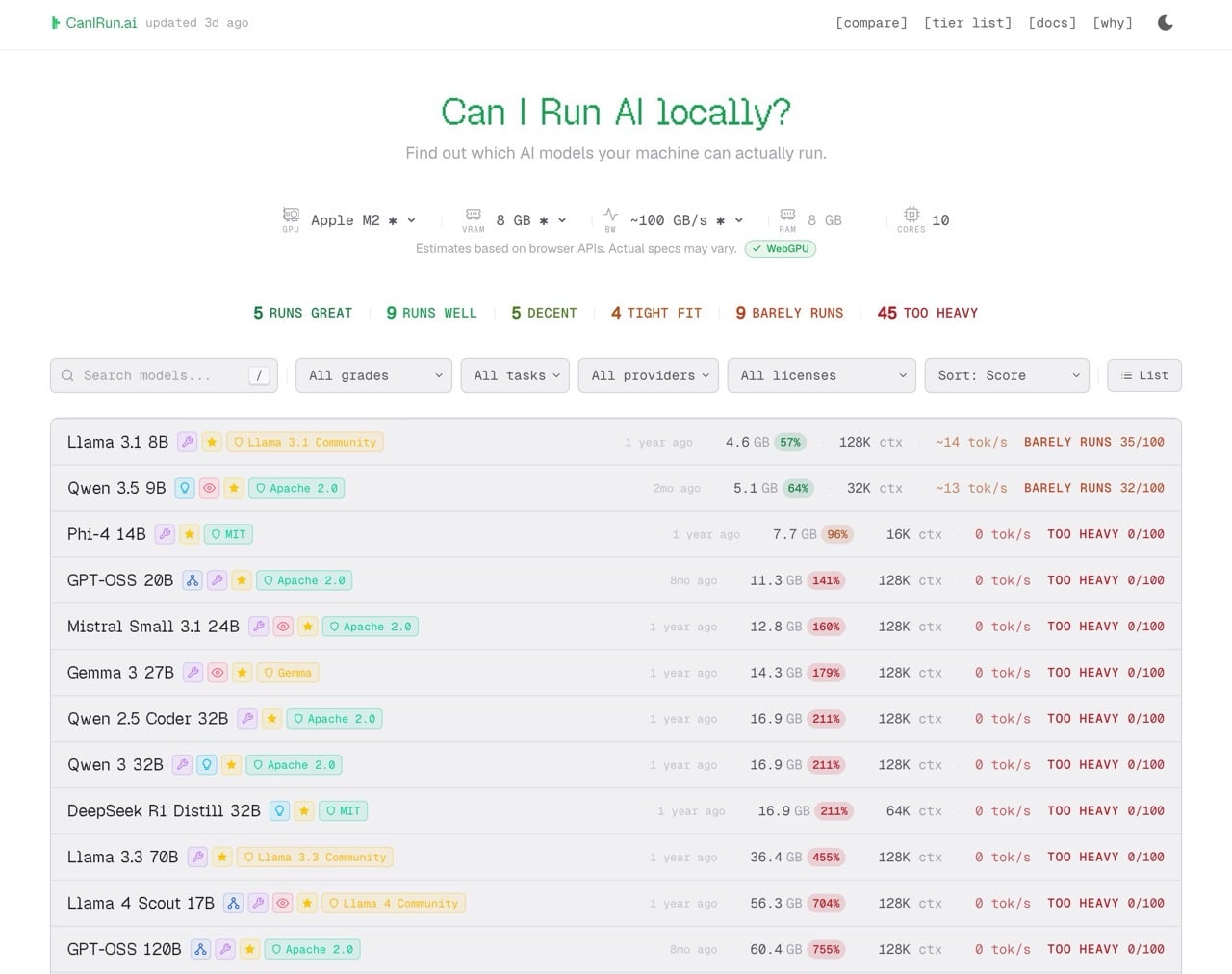

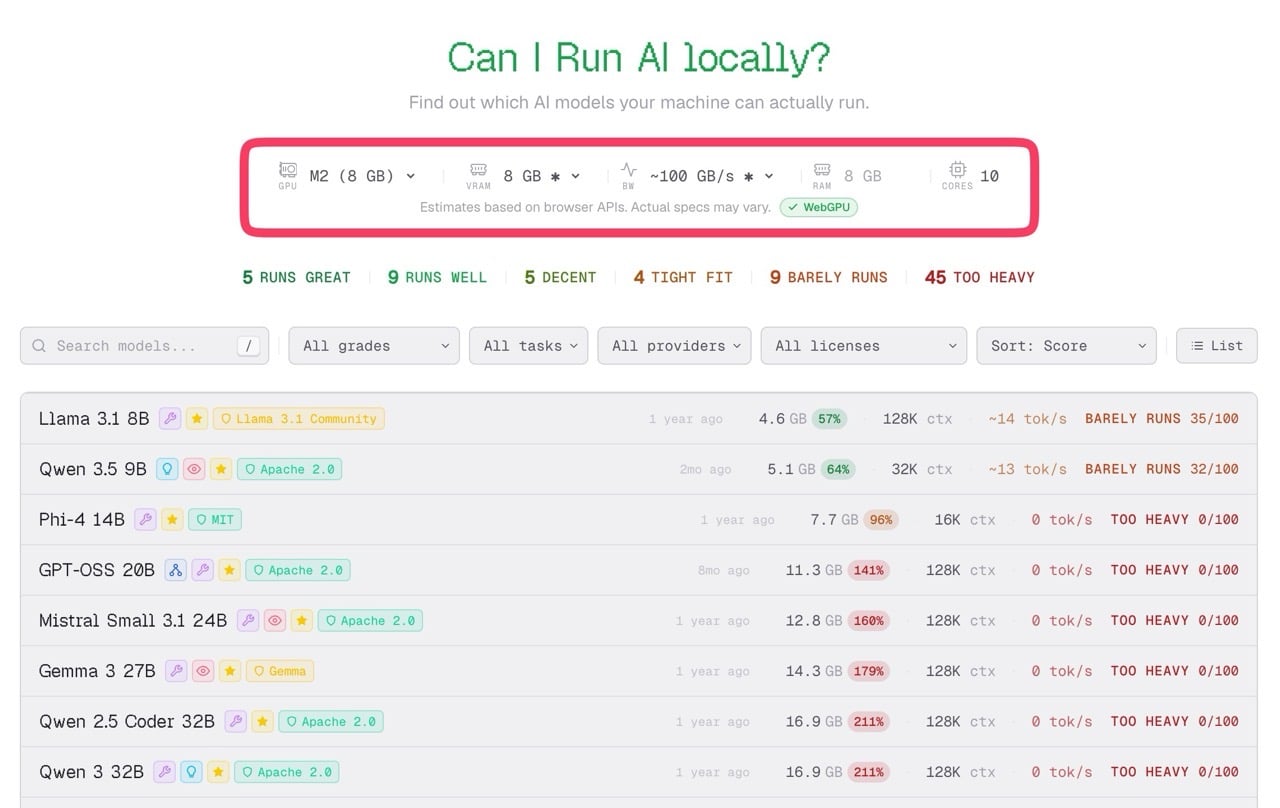

CanIRun.ai 以瀏覽器 WebGPU API 自動偵測硬體資訊,例如取得使用者的處理器、顯示卡(GPU)型號、顯卡記憶體(VRAM)、系統記憶體和網路頻寬等資訊,再從資料庫直接比對各大主流開源模型,即時計算出在使用者的硬體上能運行的預期表現,並以分級方式呈現。偵測流程都只會在瀏覽器端完成,不會有任何資訊被上傳到遠端伺服器。

CanIRun.ai 協助使用者建置離線運行的 AI 環境,確保對話內容不會經過雲端服務,提升使用者的隱私與安全性。

直觀視覺化分級評分

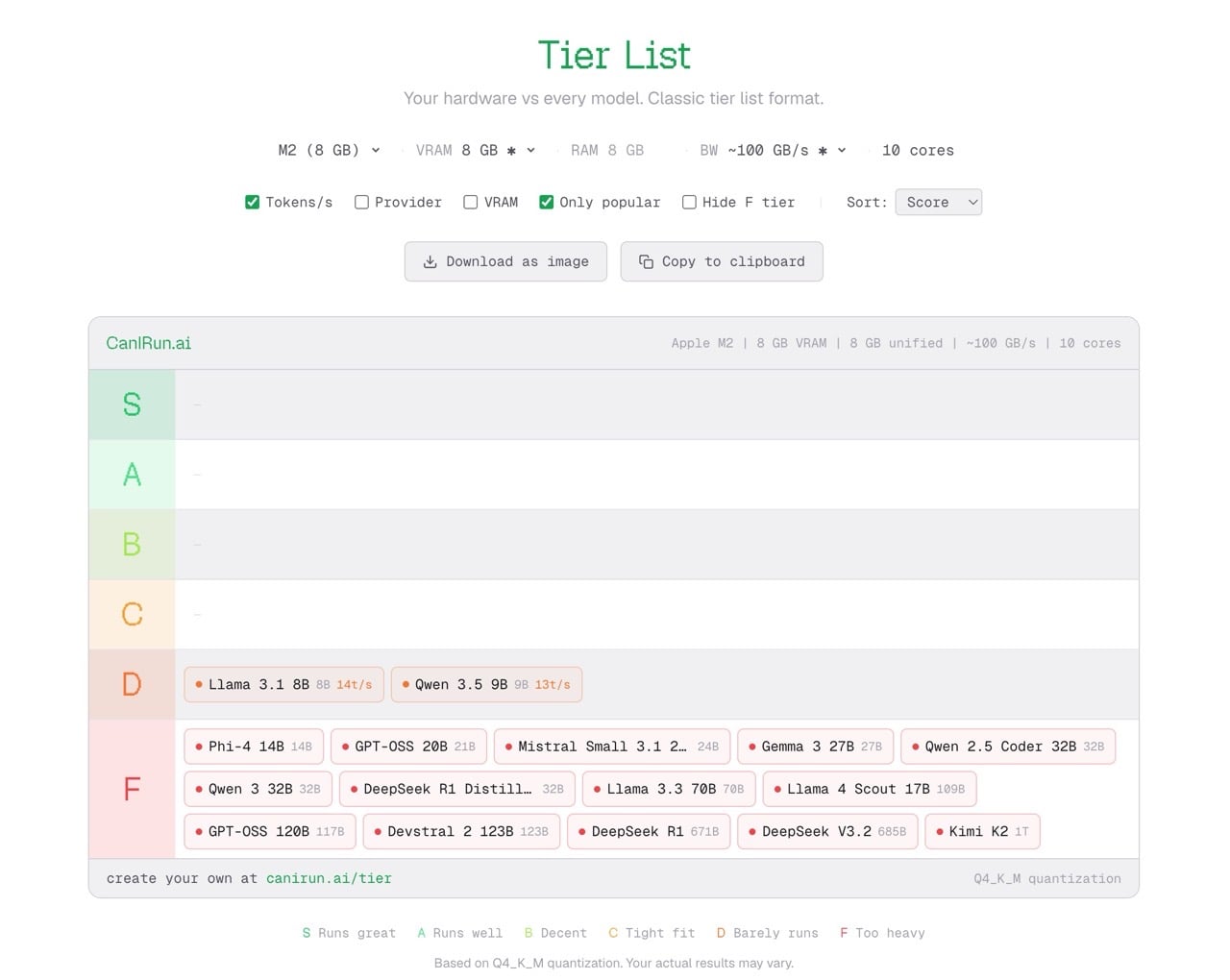

值得一提的是 CanIRun.ai 採用「視覺化分級」,以直觀的評分系統(如 S 到 F 等級)清楚顯示是「綽綽有餘」還是「勉強支撐」,也會針對每種大型語言模型提供更詳細的硬體規格要求、量化選項等資訊。

網站資訊

網站名稱:CanIRun.ai

網站鏈結:https://www.canirun.ai/

使用教學

開啟 CanIRun.ai 網站後上方就會帶入自動偵測到的硬體資訊,這是由現代瀏覽器提供的 API,讓網站獲取設備硬體的部分資訊,好處是不用透過指令列或安裝偵測軟體,操作上更簡單無痛。

硬體規格還是可以依照需求自訂,例如 GPU、VRAM、網路頻寬、記憶體和核心數。

最上方有一排彩色的文字是「視覺化分級」功能,依照可用到無法使用分成六個等級,如下:

- S 級至 B 級: 應該都能正常執行,產出內容時不會感到明顯延遲。

- C 級至 E 級: 可能將硬體資源耗盡,生成內容速度極慢。

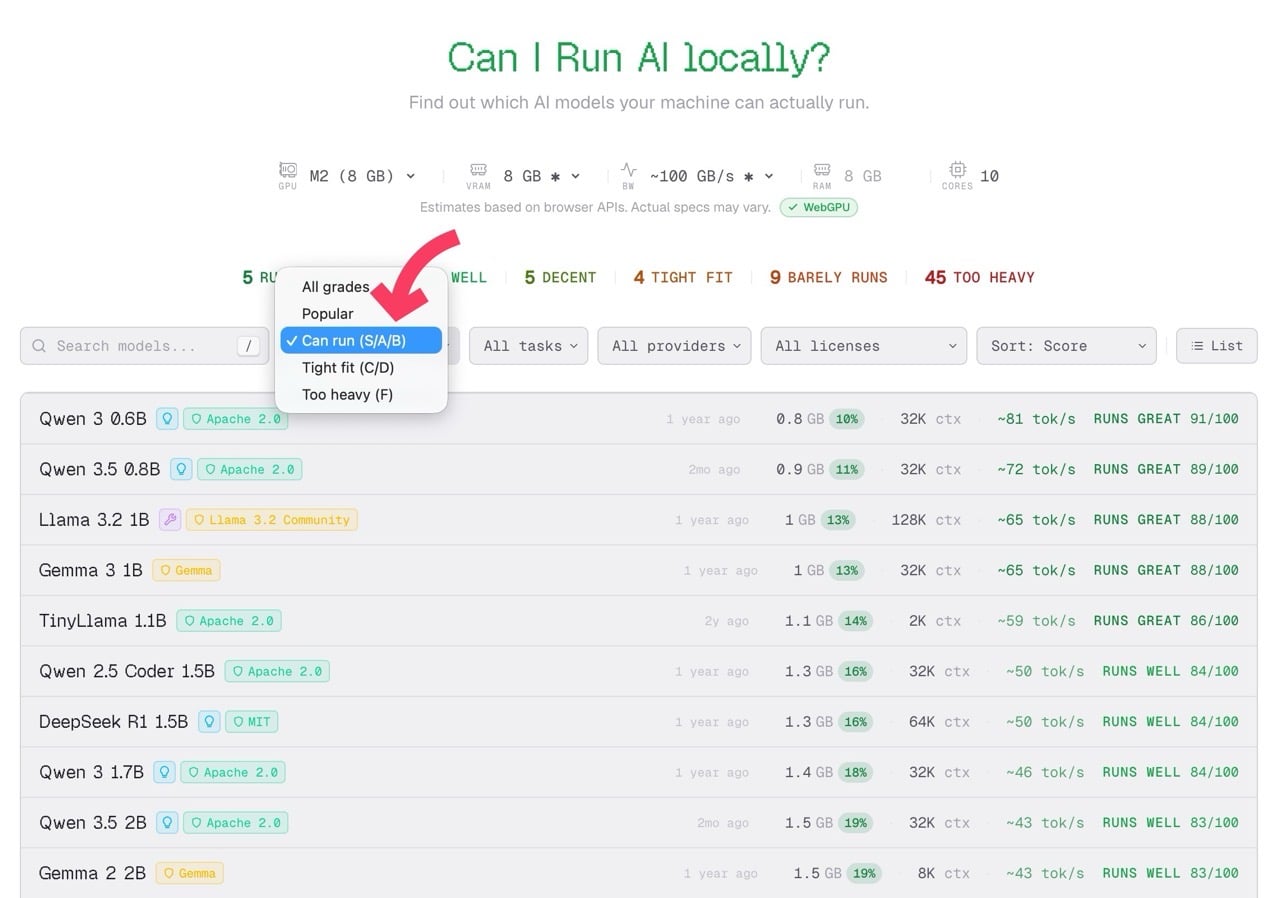

透過上方的篩選器可以直接列出包含前三個等級的 AI 模型,快速找出能正常使用的開源模型。

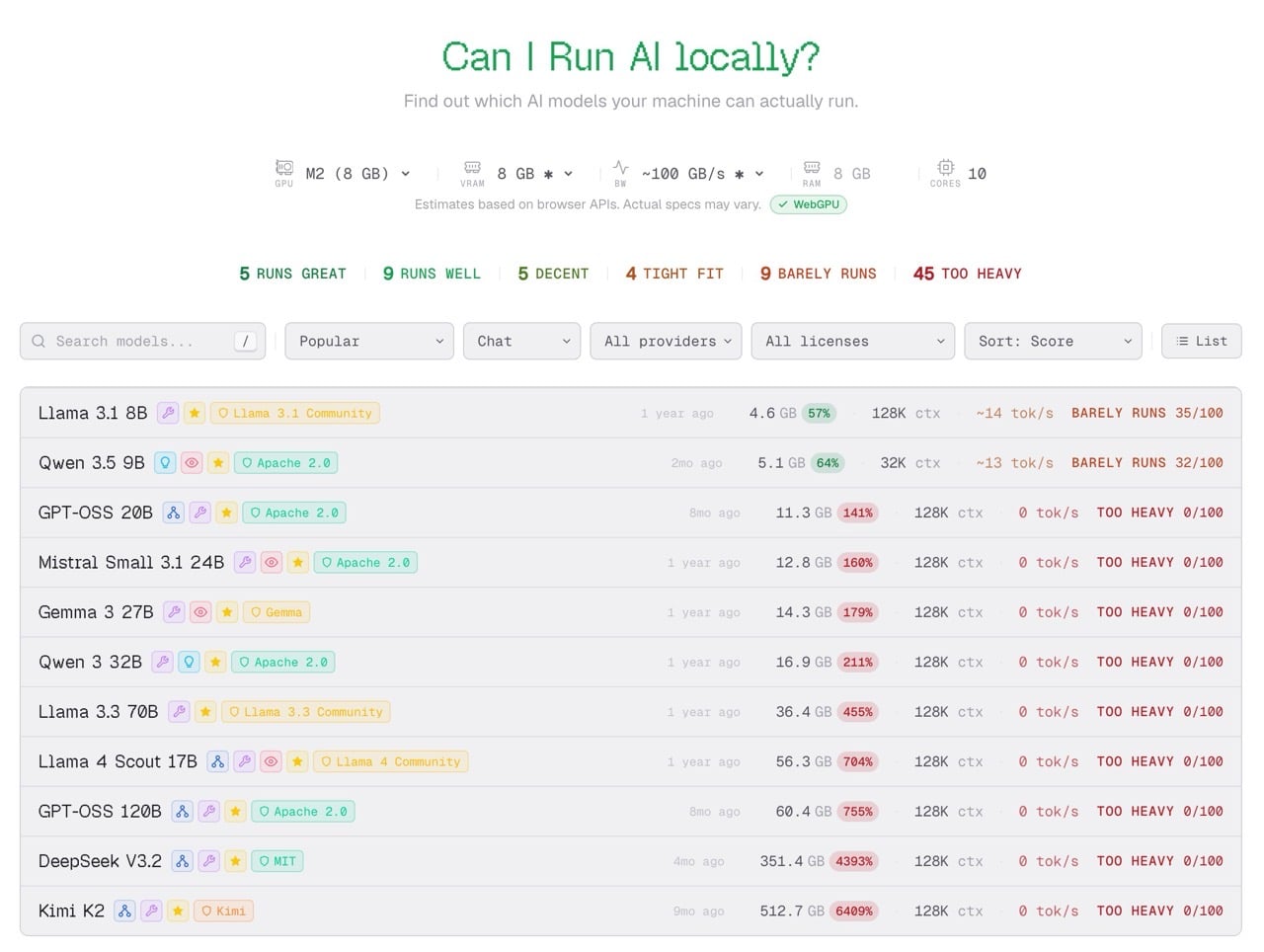

此外,上方篩選器還能調整 AI 用途(聊天、程式碼、推理)、供應商(Google、OpenAI、Meta、微軟等)、授權方式和排序條件等,下方會列出模型名稱與標籤、模型體積與資源佔用、效能預估、運行等級和評分等資訊。

舉例來說,第一個「Llama 3.1 8B」代表該模型有 80 億個參數,「4.6 GB 57%」表示模型在預設量化版本下的檔案體積大小(57 % 是該模型會佔用你現有顯卡記憶體的比例),「tok/s」則是預估每秒能生成的字數(Tokens)。

從 CanIRun.ai 右上角切換到「Tier List」頁面,會將使用者的硬體資源對比所有 AI 模型並以排名等級列出,如同前面所述一樣是視覺化分級,預設會勾選 Only popular 僅列出熱門選項,如果要查看完整模型記得取消勾選,也能從上方調整硬體資源選項,例如 GPU、顯卡記憶體和網路頻寬。

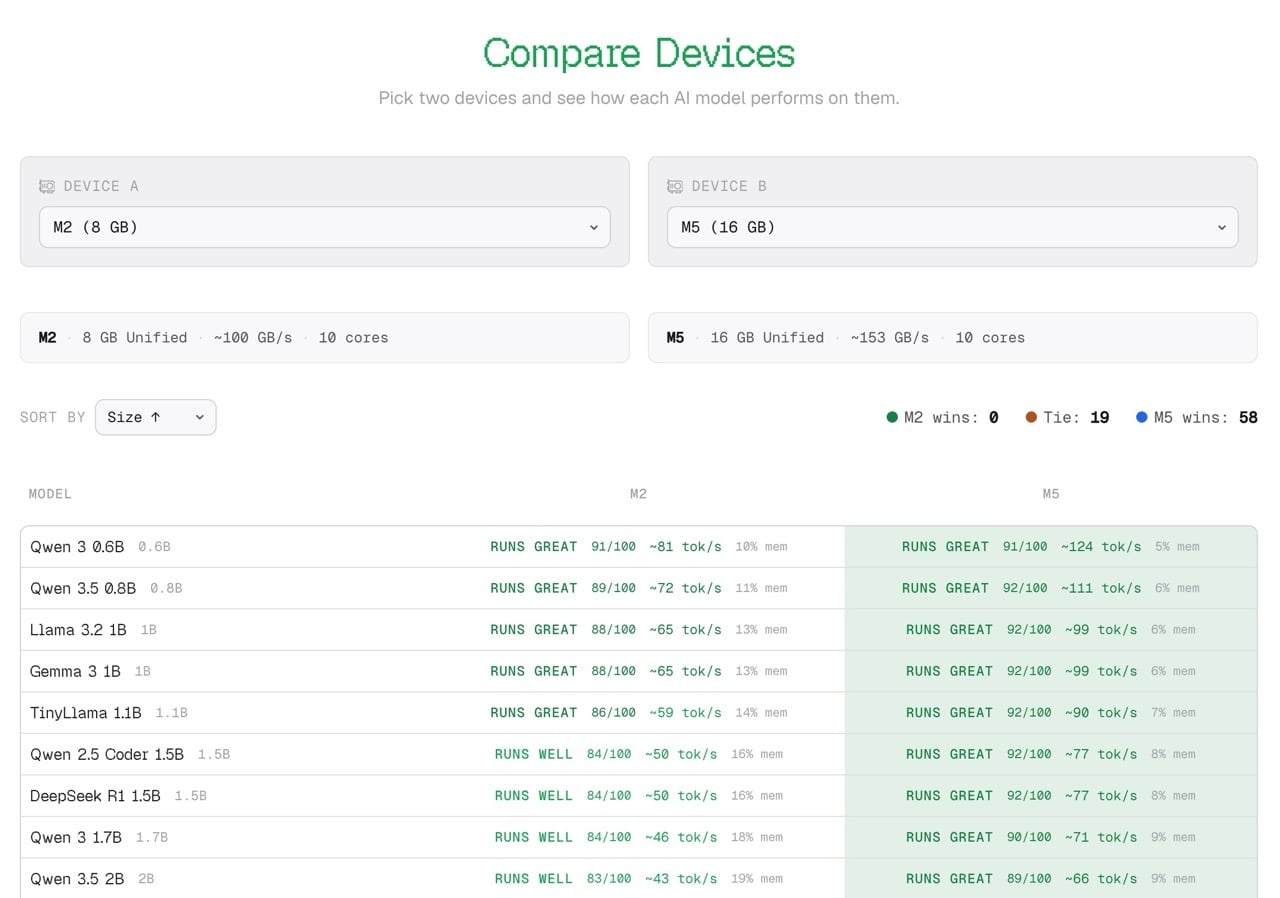

另一項「Compare Devices」功能很好用,選擇兩台不同的裝置,對比它們在所有 AI 開源模型的運行等級,有助於未來在升級或是更換裝置時作為參考使用。

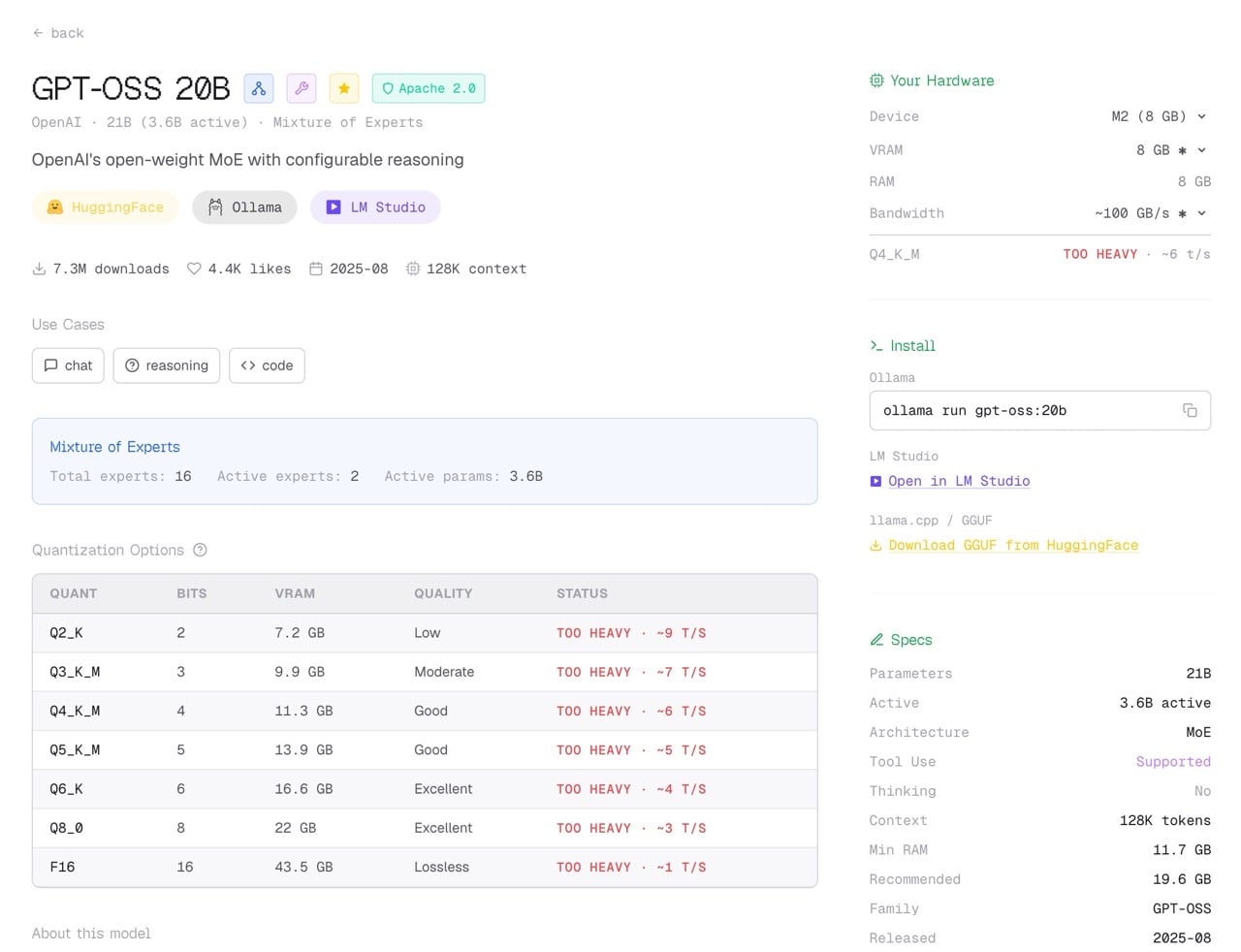

在 CanIRun.ai 有提供每一種開源模型的詳細資訊,包括模型名稱、開發商、參數規模、下載次數、釋出日期等,也能查看不同的量化版本所需要的 VRAM 大小、品質和評分狀態。

想要安裝特定的 AI 模型,頁面右側也有提供對應的資訊。

若想要部署特定大型語言模型的運行環境,在 CanIRun.ai 就能調整不同的硬體規格,預先查看在這規格下能不能順暢使用該語言模型,不過整個建置過程還是會有一定程度的技術性。